Infoclimat : un commun météorologique et climatologique à préserver !

mardi 25 janvier 2022 à 10:31Infoclimat est une association de passionné·es de météo, qui agit pour favoriser et vulgariser l’échange de données et de connaissances autour de la météo et du climat.

Nous baignons dans les mêmes eaux et partageons les mêmes valeurs : les communs culturels doivent être ouverts à toutes et tous pour l’intérêt général !

L’association va fêter ses 20 ans et se lancer dans un nouveau projet : le recrutement de son·sa premier·ère salarié·e. C’est l’occasion de donner la parole à Frédéric Ameye et Sébastien Brana, tous deux bénévoles.

Bonjour Frédéric et Sébastien, pouvez-vous vous présenter ?

Frédéric Ameye (FA), 27 ans, je suis ingénieur dans les systèmes embarqués pendant les heures ouvrables… et en-dehors de ça, je suis depuis longtemps « Linuxien » et (modeste) défenseur du logiciel libre, mais aussi de l’égalité des chances à l’école — issu d’une famille ouvrière très modeste, c’est quelque chose qui me tient beaucoup à cœur. Le reste du temps (quand il en reste), vous me trouverez principalement en rando au fin fond de la montagne…

J’ai intégré l’aventure Infoclimat en 2009 (j’avais alors 15 ans), période à laquelle j’ai « refondu » le site web de l’asso à partir de l’ordinateur familial à écran cathodique, que je monopolisais des dizaines d’heures par semaine, jusqu’à très tard dans la nuit. J’ai continué ce rôle jusqu’à aujourd’hui (avec un écran plat, et moins d’heures dans la nuit car la trentaine arrive vite). Entre-temps, j’ai rejoint le Conseil d’Administration, et je suis ensuite devenu Vice-Président en 2015.

Sébastien Brana (SB), 42 ans. Dans la vie « hors Infoclimat », je suis chef de projet informatique à la Direction générale des finances publiques… et comme Frédéric, en dehors de « ça », j’occupe une grande partie de mon temps libre (soirées, week-end et congés) au profit du site et de l’association que j’ai rejoint en 2005 et dont je suis également Vice-Président depuis 12 ans. Au-delà des phénomènes météo (orages et chutes de neige notamment) qui m’ont toujours fasciné depuis aussi loin que je me souvienne, je suis également passionné par la communauté que nous avons formée depuis une vingtaines d’années, rassemblant des personnes de tous âges (des gamins de 10 ans aux retraités) et de tous milieux, amateurs ou professionnels, scientifiques ou littéraires, ou simplement amoureux de beaux paysages et de photographies. La météo touche tout le monde, les questions liées au climat interrogent tout le monde – bref, ces sujets intéressent voire passionnent bien au-delà des barrières sociales habituelles !

Vous êtes membres bénévoles de Infoclimat, pouvez-vous nous parler du projet de l’association ?

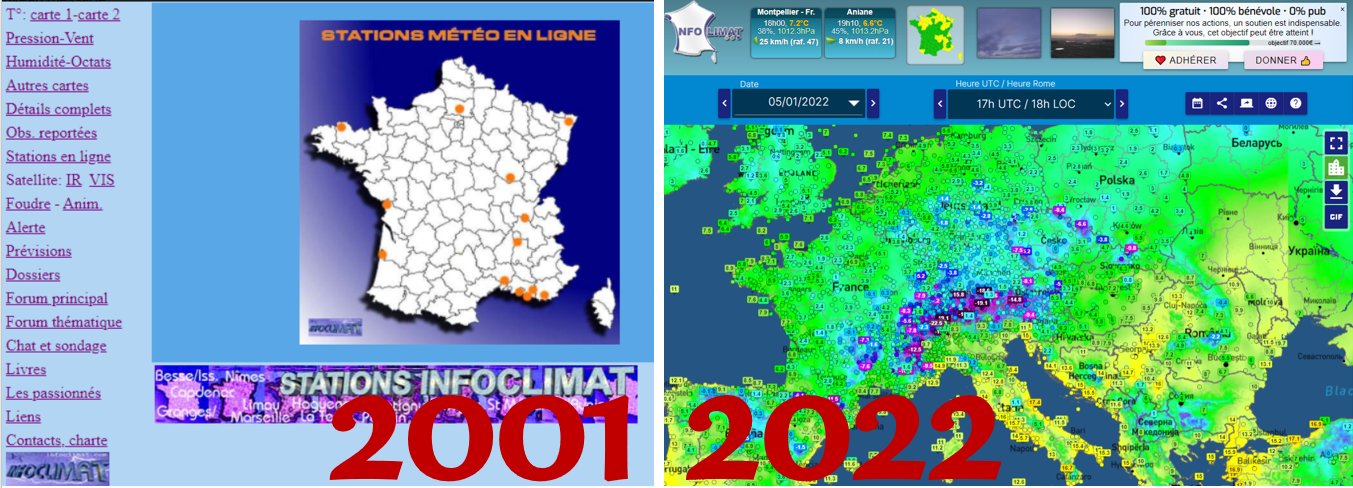

SB : Initialement, Infoclimat était un petit groupe de passionnés de météo et de climat, qui partageaient leurs relevés entre-eux à la fin des années 90, sur un site web appelé « OrageNet ». Tout cela a progressivement grossi, jusqu’à l’année 2003, où l’association a été créée principalement pour subvenir aux besoins d’hébergement du site web. A l’époque, nous étions déjà (et sans le savoir !) en « Web 2.0 » et pratiquions les sciences participatives puisque l’essentiel du contenu était apporté par les passionnés ; nous étions alors bien loin d’imaginer que les problématiques liées au climat deviendraient un enjeu mondial avec une telle résonance médiatique.

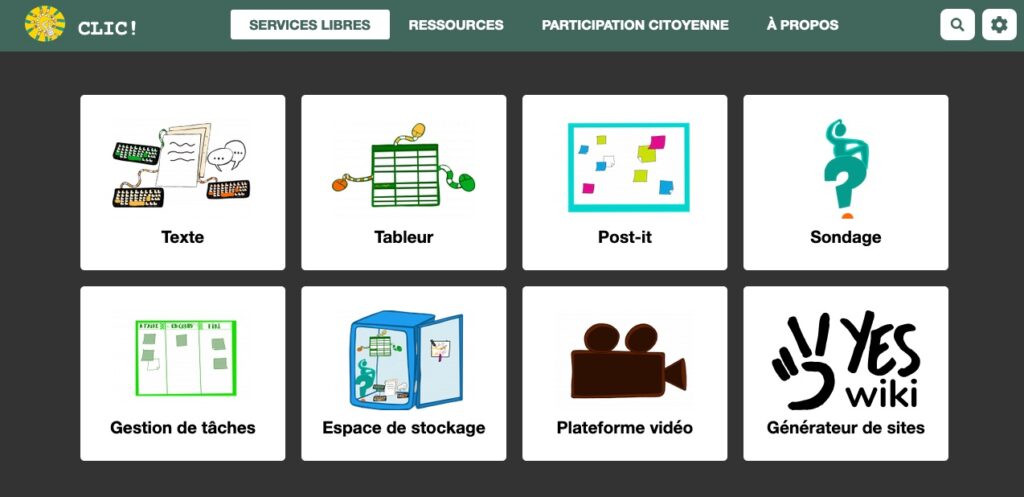

Infoclimat a beaucoup évoluée, entre les débuts sur un internet confidentiel des années 90 dédié au partage, au web d’aujourd’hui.

FA : Depuis, l’objet social s’est considérablement diversifié, avec la montée en puissance de notre asso. Aujourd’hui, nous visons trois thématiques particulières :

- L’engagement citoyen au service de la météo et du climat : partager ses relevés, ses observations météo, installer des stations météorologiques,… au service de tous ! Cela permet de comprendre comment le climat change, mais aussi de déceler des particularités locales que les modèles de prévision ne savent pas bien prendre en compte, ou qui ne peuvent pas être mesurées facilement.

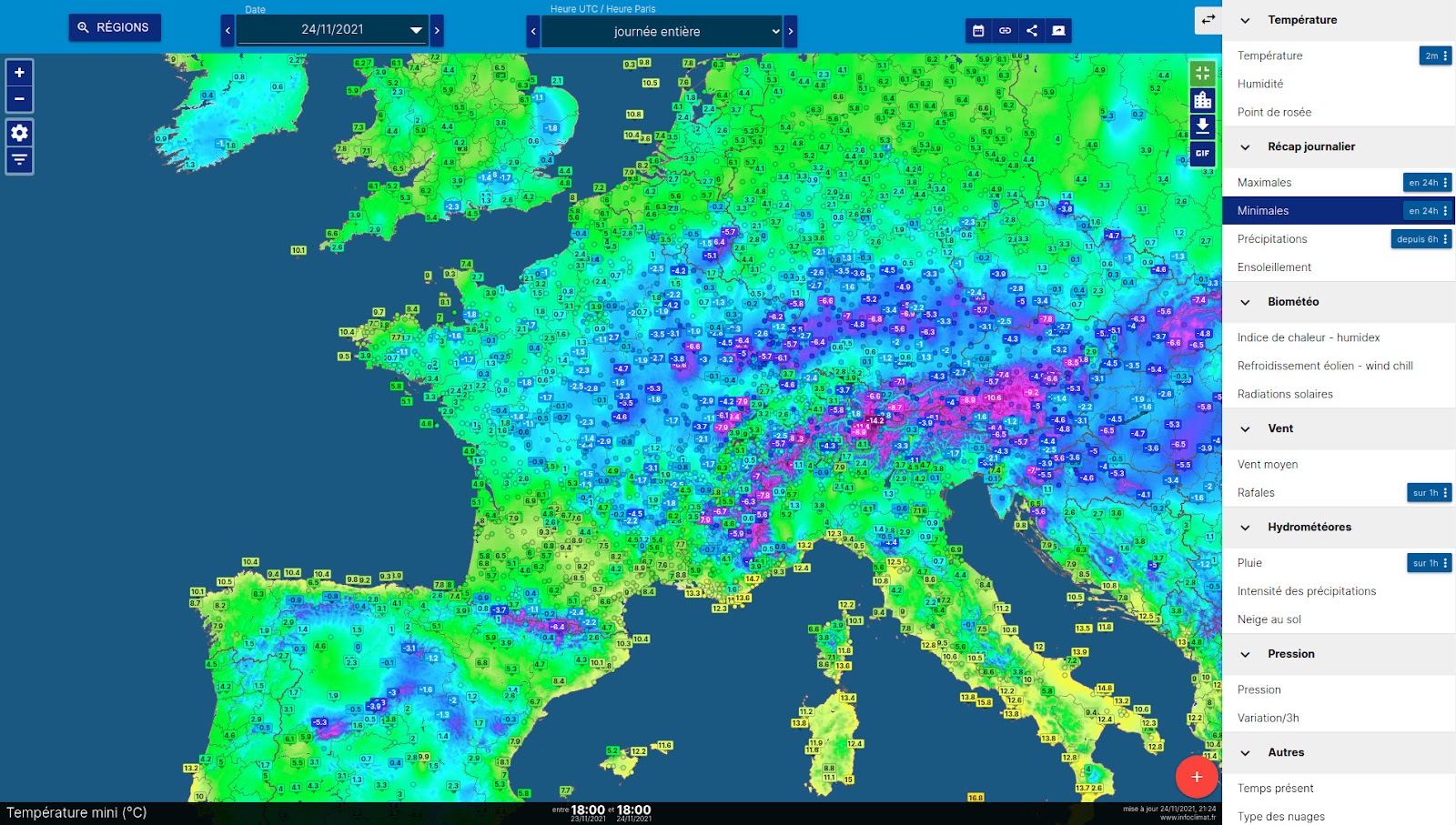

- Valoriser la donnée météo et climato, qu’elle soit issue de services officiels ou diffusée en « OpenData » par nous ou nos passionnés, et en particulier en faire des outils utiles autant aux « pros » et chercheurs, qu’au service de la vulgarisation des sujets climatiques pour le grand public. Les utilisations sont très nombreuses : agriculture, viabilité hivernale, thermique dans l’habitat, recherches sur le changement climatique, production électrique, journalistes…

- Former et transmettre les connaissances, par la production de contenus de vulgarisation scientifique, l’organisation de « rencontres météo », ou encore des interventions auprès des écoles, dans des événements sur le terrain ou sur les réseaux sociaux. Bref, contrer la désinformation et le buzz !

Quand Infoclimat débarque quelque part, c’est rarement pour pique-niquer… Mais plutôt pour installer du matériel météo !

Vous faites donc des prévisions météo ?

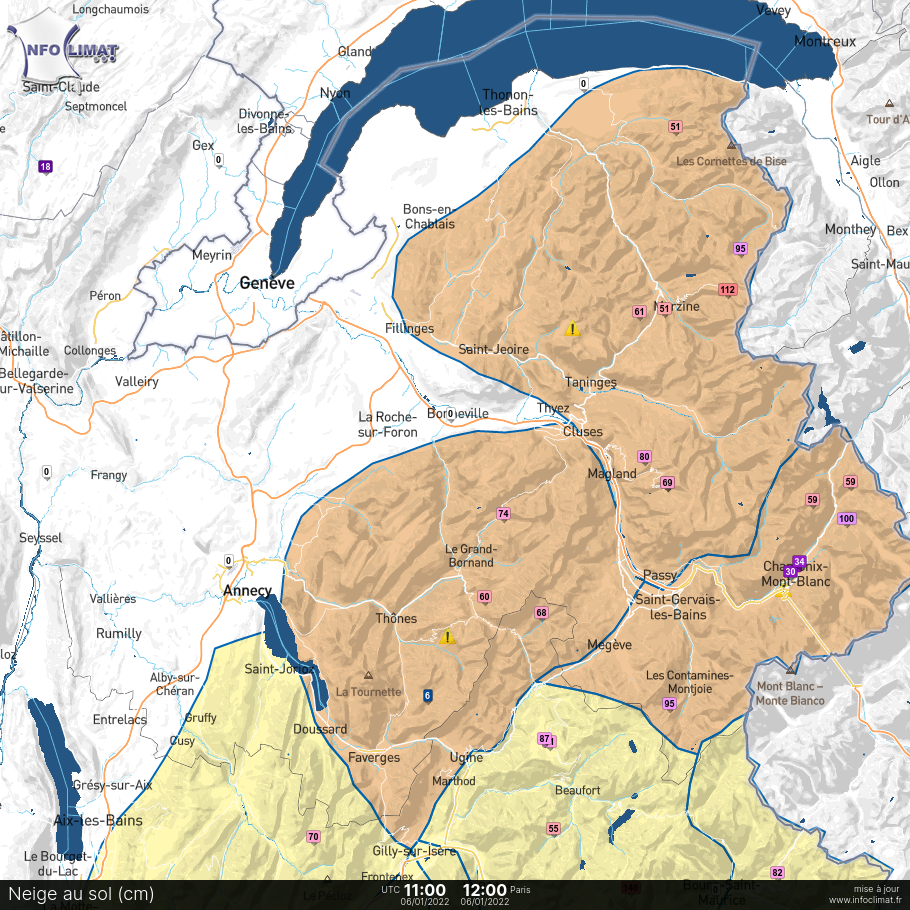

SB : Même si le forum est largement animé par des prévisionnistes amateurs, nous parlons finalement assez peu de prévisions météo : le cœur du site, c’est l’observation météo en temps réel et la climatologie qui résulte des données collectées, qui sont des sujets bien différents ! Il y aurait tant à dire sur le monde de la prévision météo, mais cela mériterait un article à lui seul, car il y a un gros sujet là aussi sur l’ouverture des données et la paternité des algorithmes… Souvent négligée, l’observation météorologique est pourtant fondamentale pour produire une bonne prévision. Pour faire court, la donnée météo « observée » est la nourriture qu’il faut pour entraîner les modèles climatiques, et faire tourner les modèles numériques qui vous diront s’il faut un parapluie demain sur votre pixel de 1km².

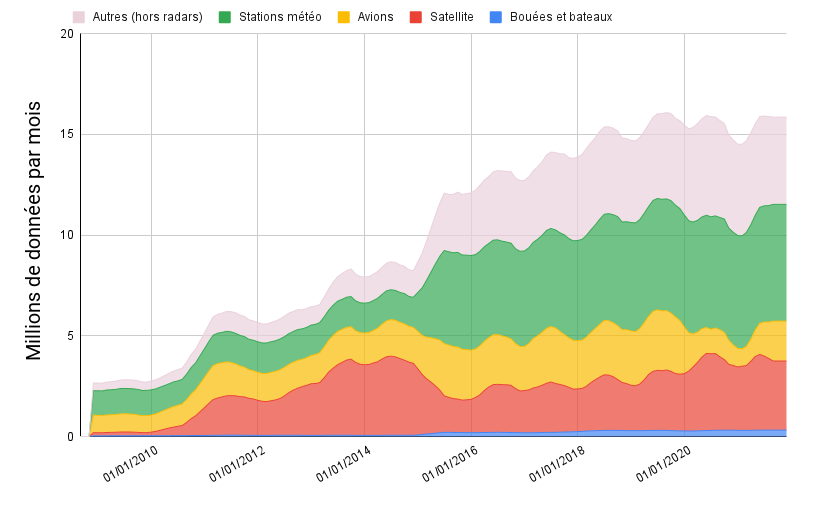

Quantité d’observations météo intégrées dans le modèle de prévisions français « AROME », source principale de toutes les prévisions en France métropolitaine. La performance des modèles météorologiques est fortement corrélée à la quantité, la fréquence, et à la qualité de leurs données d’entrées (observations radar, satellite, avions, stations météo au sol,…). La quantité d’observations des stations Météo-France est à peu près équivalente à la quantité de données produites par les passionnés d’Infoclimat. Graphique simplifié, hors données radar. Avec l’aimable autorisation de Météo-France et du CNRM.

FA : Ce qu’il faut savoir, c’est que l’immense majorité des sites internet ou appli que vous consultez ne font pas de prévisions météo, mais utilisent des algorithmes automatisés qui traitent des données fournies (gratuitement ou avec redevance) par les organismes publics (Météo-France, la NOAA, le Met-Office, l’organisme européen ECMWF,…). La qualité des prévisions est en gros corrélée à l’argent que les créateurs des sites et des applis peuvent injecter pour récolter des données brutes de ces modèles numériques. Par exemple, pour avoir les données du modèle de Météo-France « AROME », c’est à peu près gratuit car les données sont sous licence Etalab, mais si vous voulez des données plus complètes, permettant d’affiner vos algorithmes et de proposer « mieux », c’est sur devis.

Dès lors, Infoclimat ne souhaite pas se lancer dans cette surenchère, et propose uniquement des prévisions automatisées issues de données ouvertes de Météo-France et de la NOAA, et indique très clairement la différence entre prévisions automatisées et bulletins rédigés par des passionnés.

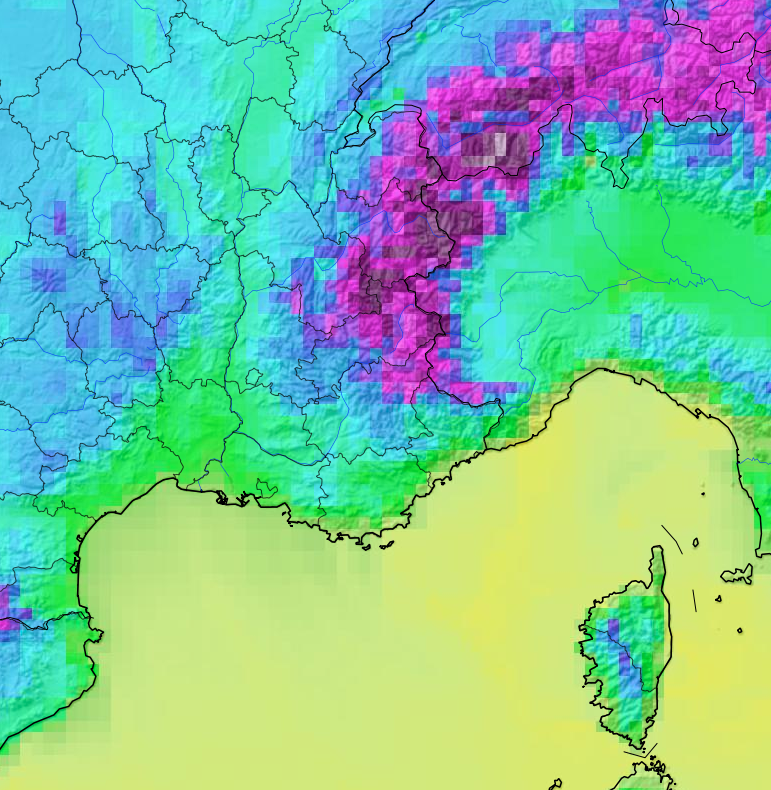

La Terre est découpée en petits cubes dans lesquels les modèles météo estiment les paramètres de l’atmosphère à venir. Les cubes sont généralement bien plus gros lorsque les échéances sont lointaines (J+4, J+5…), ce qui empêche les modèles météorologiques de discerner les phénomènes météo de petite échelle (averses, orages, neige, effets des reliefs et des côtes). Pourtant, de nombreuses appli météo se contentent de vous fournir grossièrement ces données sans l’explication qui va avec. Chez Infoclimat, on laisse volontairement la résolution native, pour ne pas induire le lecteur en erreur sur la résolution réelle des données.

Cela me fait toujours rire (jaune) quand j’entends « [site ou appli] a de meilleures prévisions à chaque fois, et en plus, on les a à 15 jours ! » : lorsqu’il s’agit de prévisions « automatiques », par ville, il est probable qu’il utilise les mêmes données que tous les autres, présentées légèrement différemment, et qu’il s’agisse juste d’un biais de confirmation. Il existe bien sûr quelques exceptions, certaines entreprises faisant un vrai travail de fusion de données, d’analyse, de suppression des biais, pour proposer des informations de très grande qualité, généralement plutôt payantes ou pour les pros. Mais même chez ceux qui vous vendent du service d’aide à la décision, de protection des biens et des personnes, des données expertisées ou à vocation assurantielles, vous seriez très surpris de la piètre qualité de l’exploitation qui est faite de ces données brutes.

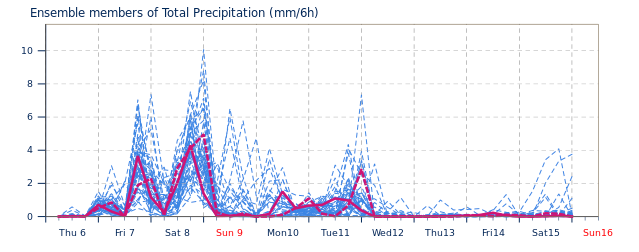

Les modélisateurs météo ont plein de techniques pour prendre en compte les incertitudes dans les observations et les modèles, notamment ce que l’on appelle la « prévision ensembliste ». Mais ces incertitudes sont rarement présentées ou expliquées au public. Ici par exemple, le graphique présente la quantité de pluie prédite par un modèle météo le 6 janvier, pour la période entre le 6 janvier et le 16 janvier 2022, sur un point de la France. Le modèle considère plusieurs scénarios d’évolution possible des futurs météorologiques. Source : ECMWF, CC BY 4.0.

Malheureusement, cette situation rend très délicate la perception des prévisions météo par le grand public (« ils se trompent tout le temps ») : la majorité des applis prend des données gratuites, de faible qualité, sur le monde entier, qui donnent une prévision différente 4 fois par jour au fil des calculs. Cela ne met vraiment pas en valeur le travail des modélisateurs, qui font pourtant un travail formidable, les modèles numériques s’améliorant considérablement, et décrédibilisent aussi les conclusions des organismes de recherche pour le climat (« ils ne savent pas prévoir à 3 jours, pourquoi ils sauraient dans 50 ans ? ! »), alors qu’il s’agit surtout d’une exploitation maladroite de données brutes, sans accompagnement dans leur lecture.

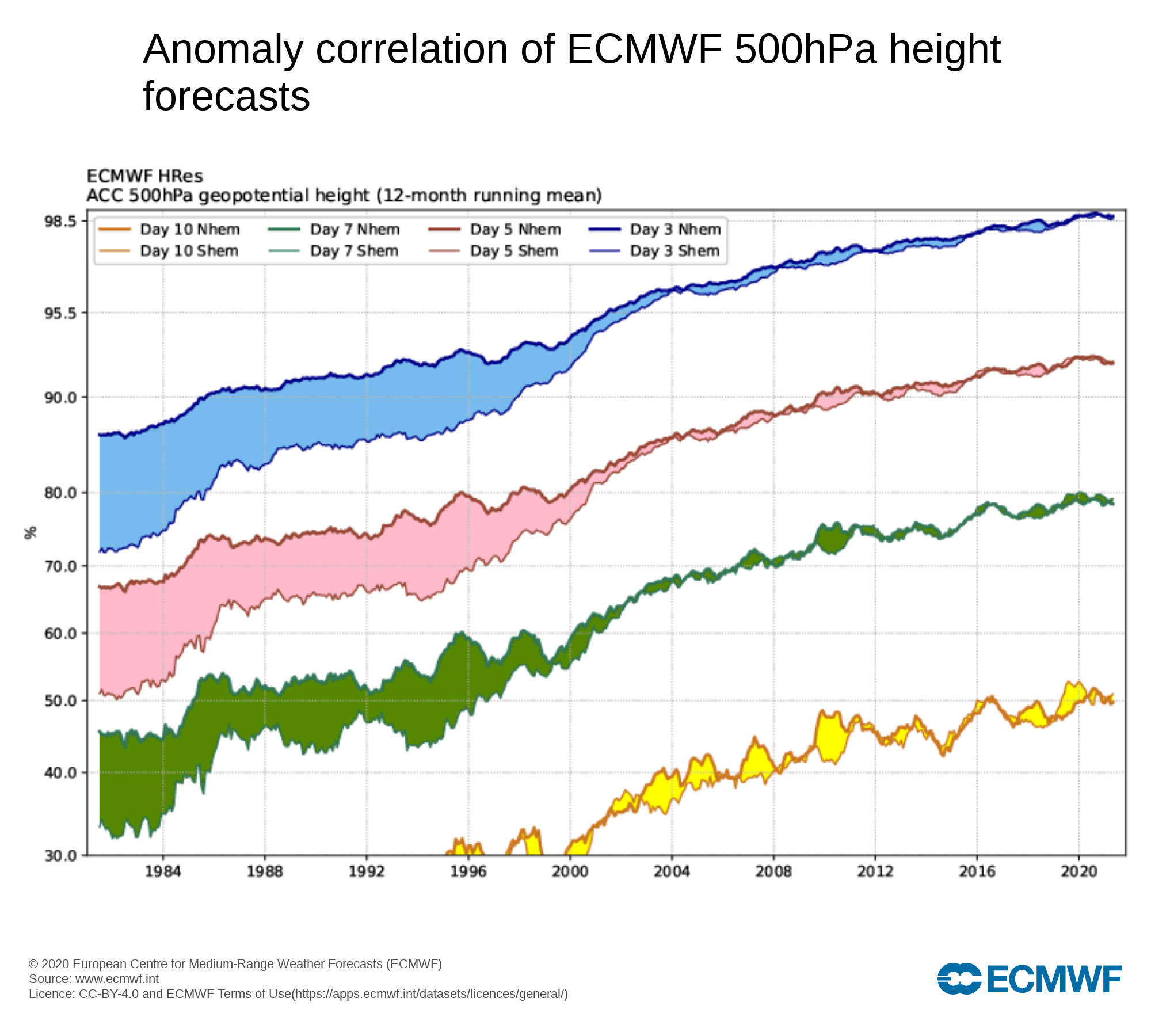

Ce graphique présente, grosso-modo, l’amélioration de la qualité des prévisions de l’état de l’atmosphère au fil des années, à diverses échéances de temps (jaune = J+10, vert = J+7, rouge = J+5, bleu = J+3) et selon les hémisphères terrestres. Plus c’est proche de 100 %, meilleures sont les prévisions ! Source : ECMWF, CC BY 4.0.

Du coup, quelles actions menez-vous ?

FA : Notre action principale, c’est la fourniture d’une plateforme sur le web, qu’on assimile souvent au « Wikipédia de la météo », ou à un « hub de données » : nous récoltons toutes sortes de données climatiques et météorologiques de par le monde, pour les décoder, les rendre digestes pour différents publics, et la mettre en valeur pour l’analyse du changement climatique. Ce sont par exemple des cartographies, ou des indices d’évolution du climat. C’est notre rôle initial, qui aujourd’hui compile plus de 6 milliards de données météo, à la qualité souvent rigoureusement contrôlée par des passionnés ! Il faut savoir que nous n’intégrons pas toutes les stations météo : nous respectons des normes de qualité du matériel et de l’environnement, pour que les données soient exploitables et comparables entre-elles, comparables avec des séries climatiques historiques, et assimilables dans des modèles numériques de prévision.

Infoclimat propose l’accès à toutes les informations météo et climatiques dans des interfaces qui se veulent simples d’accès, mais suffisamment complètes pour les plus experts. Dur équilibre !

SB : Avec l’accroissement de notre budget, nous avons pu passer à l’étape supérieure : installer nos propres stations météo, et soutenir les associations locales et les passionnés qui en installent et qui souhaitent mettre leurs données au service d’une base de données commune et libre.

Les passionnés ne reculent devant rien pour l’intérêt général. Aller installer une station météo à Casterino, village des Alpes Maritimes qui s’est retrouvé isolé de tout après la tempête Alex ? C’est fait, et avec le sourire malgré les kilomètres avec le matériel sur le dos ! Retrouvez l’article ici

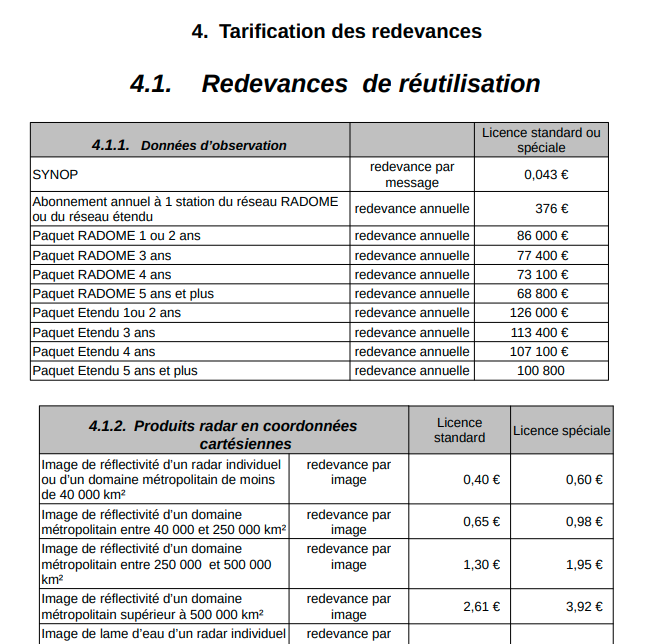

Il faut savoir que la donnée météo se « monnaye », et chèrement : Météo-France, par exemple, ne met à disposition du grand public que quelques pourcents de ses données, le reste étant soumis à des redevances de plusieurs centaines de milliers d’euros par an (on y reviendra). Ce n’est d’ailleurs pas le cas dans tous les pays du monde, les États-Unis (NOAA) ont été précurseurs, beaucoup de pays Européens s’y mettent, mais la France est un peu en retard… Nous sommes partenaires de Météo-France, participons à des travaux communs dans le cadre du « Conseil Supérieur de la Météorologie », mais c’est très long, trop long, et cela prive Météo-France d’une source de revenus importante dans un contexte de stricte restriction budgétaire. L’établissement public administratif se retrouve en effet pris dans une injonction contradictoire par son autorité de tutelle (le Ministère de la Transition écologique et solidaire) : d’un côté il doit « libérer » les données publiques et mettre en place les infrastructures nécessaires, de l’autre, on lui intime l’ordre de trouver de nouvelles sources de financement par sa branche commerciale, et on lui réduit ses effectifs !

Redevances demandées par Météo-France pour accéder aux données météo de son réseau « RADOME » (90 % des stations françaises). Hors de portée de notre association ! Source

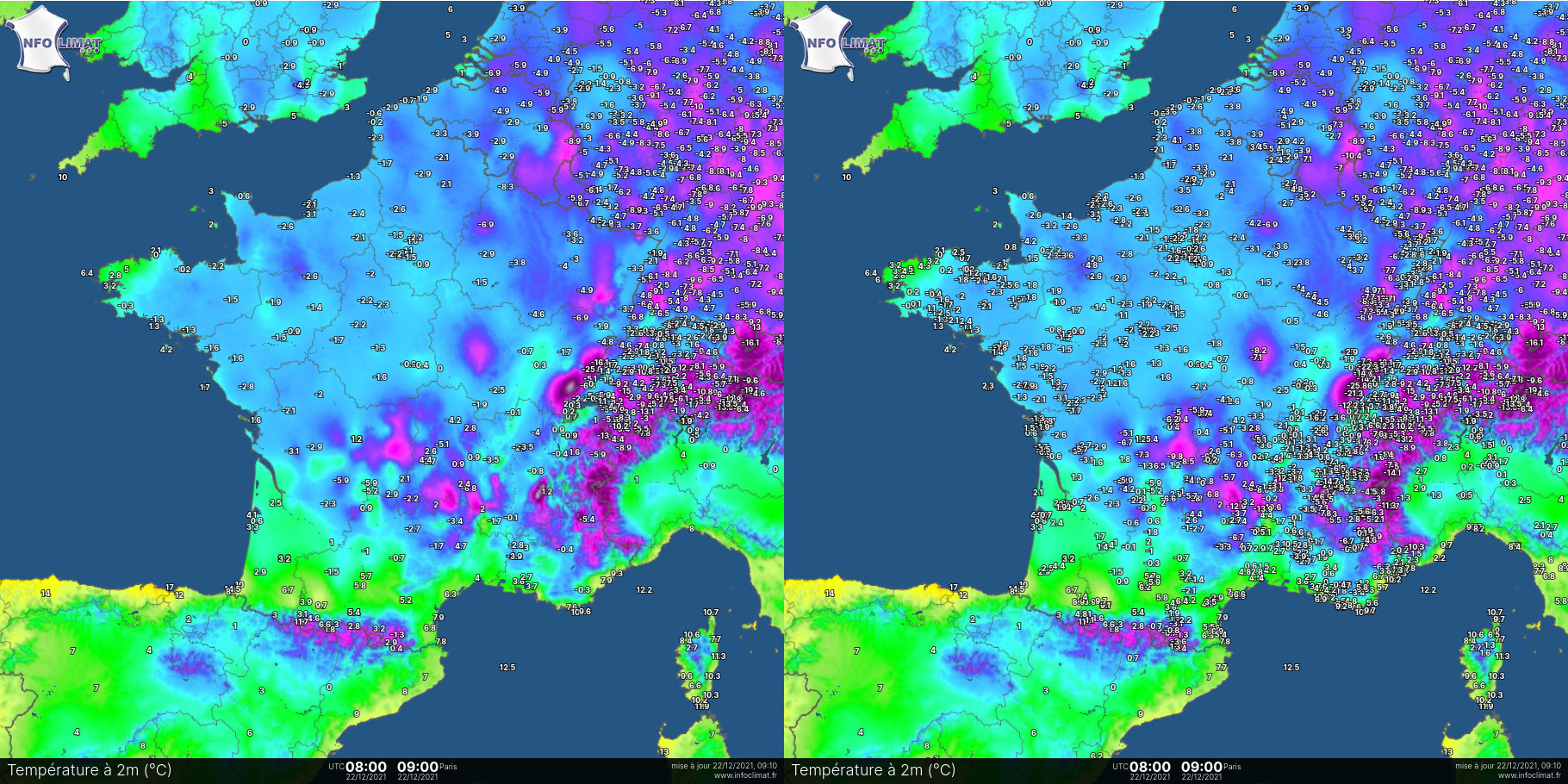

Le réseau de stations en France, avec les données ouvertes de Météo-France (à gauche), et avec les données Infoclimat et partenaires en plus (à droite). Remarquez le contraste avec certains autres pays Européens !

Aujourd’hui, Infoclimat c’est donc un bon millier de stations météo (les nôtres, celles des passionnés, et de nos associations partenaires), qui complètent les réseaux nationaux dans des zones non couvertes, et qui permettront à l’avenir d’améliorer la fiabilité des modèles météo de Météo-France, dans des travaux que nous menons avec eux sur l’assimilation des réseaux de données partenaires. Parfois d’ailleurs, nous réinstallons des stations météo là où Météo-France est parti ou n’a pas souhaité améliorer ou maintenir des installations, comme au Mont-Ventoux (84), ou à Castérino (06). Et ces données intéressent une multitude d’acteurs, que nous découvrons souvent au hasard des installations : au-delà de l’intérêt pour la météo des particuliers (« combien fait-il au soleil ? » « quelle quantité de pluie est tombée la nuit dernière ? »), les activités professionnelles météo-sensibles allant de l’agriculture à l’expertise en assurance, en passant par les études de risques et/ou d’impacts jusqu’aux recherches sur les « ICU » (ilots de chaleurs urbains observés dans les milieux urbanisés) se montrent très demandeuses et n’hésitent pas à se tourner vers nous pour leur fournir de la « bonne data-météo ».

Réhabiliter une station météo au sommet du Mont-Ventoux : check. Les données météo sont par ici.

Enfin, le troisième pilier, c’est la pédagogie. Nous avons repris en 2018, à nos frais et sans aucune subvention, l’initiative « Météo à l’École », qui avait été lancée en 2008 par le Ministère de l’Éducation Nationale avec Météo-France et l’Observatoire de Paris, mais qui a failli disparaître faute de budget à la fin du « Grand Emprunt ». L’objectif : sensibiliser de manière ludique les publics du primaire et du secondaire aux enjeux de la météo et du climat. Installer une station météo dans un collège permet de faire un peu de techno, traiter les données en faisant des maths, des stats et de l’informatique, et enfin les analyser pour parler climat et Système Terre.

Aujourd’hui, nous hébergeons les données des quelques 60 stations, ainsi que les contenus pédagogiques de Météo À l’École, permettant aux profs d’échanger entre eux.

Installer des stations météo dans les écoles, expliquer les concepts de la météo et du climat, « jouer » avec des données, et discuter entre profs : c’est ce que permet le programme Météo à l’École

Depuis de nombreuses années, nous complétons cela avec des interventions auprès des jeunes et moins jeunes, sous forme d’ateliers ou de journées à thème (« Rencontres Météo et Espace », « Nuit des Chercheurs », « Fête du Vent »,…), un peu partout en France selon la disponibilité de nos bénévoles !

Lors des Rencontres Météo et Espace organisées par le CNES, Infoclimat et Météo-France, les enfants apprennent par exemple comment on mesure les paramètres en altitude dans l’atmosphère, grâce aux ballons sondes.

Nous aimons autant apprendre des choses aux très jeunes (à gauche), qu’aux moins jeunes (à droite), lors d’événements tout-publics.

Quelles valeurs défendez-vous ?

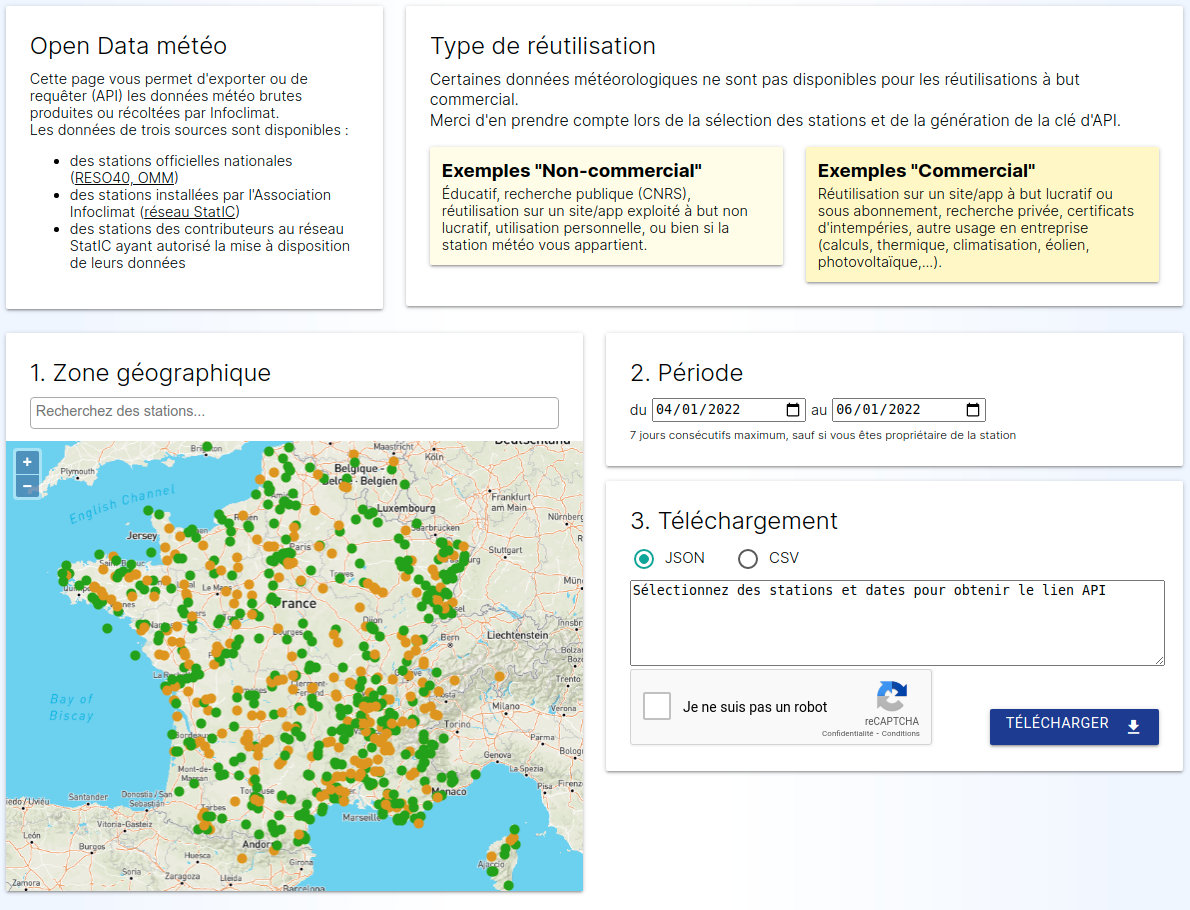

FA : La première de nos valeurs, c’est l’intérêt général ! Ce que nous avons conçu au cours de ces vingt dernières années n’appartient à personne, c’est un commun au service de tous, et pour certaines informations, c’est même le point de départ d’un cercle vertueux de réutilisation, par la libération des données en Open-Data.

La page OpenData d’Infoclimat, qui permet de s’abstraire des complexités des formats météo, des différents fournisseurs, et tente de résoudre au mieux la problématique des licences des données.

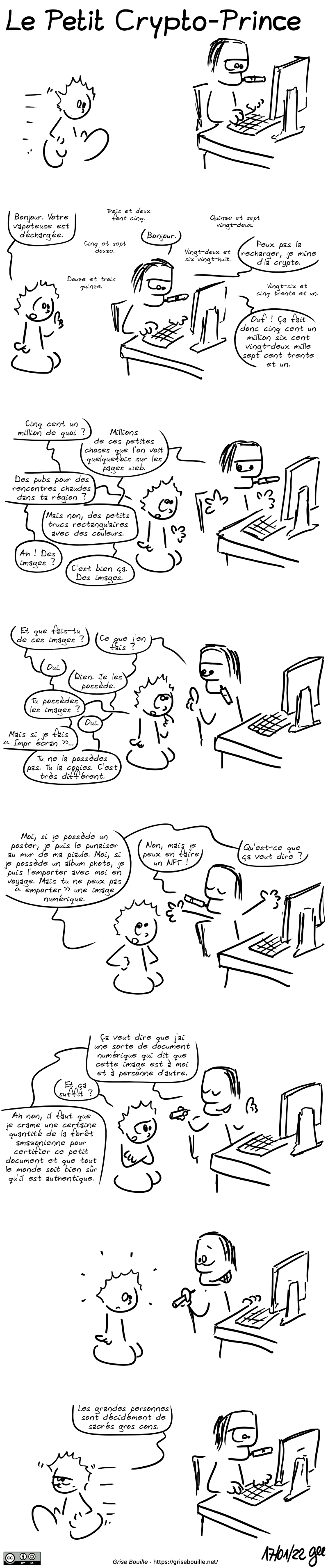

Comme on l’a dit plus haut, le monde de la météo est un juteux business. Vous trouverez pléthore de sites et applis météo, et leur composante commune, c’est que ce sont des sociétés à but lucratif qui en font un business, sous couvert d’engagement citoyen et de « communauté ». Vous y postez vos données et vos photos, et ils en tirent en retour des revenus publicitaires, quand ils ne revendent pas les données météo à d’autres sociétés (qui les mâchouillent et en font de l’analyse pour d’autres secteurs d’activité).

Parmi les initiatives similaires, on peut citer parmi les plus connues « Weather Underground » (appartenant à IBM et destinée à alimenter Watson) ou encore « Awekas » (Gmbh allemande), « Windy » (société tchèque), « Météociel » (SAS française), qui sont des sociétés privées à plusieurs centaines de milliers ou quelques millions d’euros de CA. On notera d’ailleurs que toutes ces initiatives ont des sites souvent moins complets que le notre !

On se retrouve dans une situation parfois ubuesque : ces types de sociétés peuvent acheter des données payantes à l’établissement public Météo-France (pour quelques centaines de milliers d’euros par an), et les proposent ensuite à tous sur leur site web, rémunéré par la publicité ou par abonnement à des fonctionnalités « premium ». Alors qu’elles pourraient bénéficier à tous dans une base de données librement gérée comme celle d’Infoclimat, et aussi servir nos outils d’analyse du changement climatique ; il faut passer obligatoirement par les sites de ces sociétés privées pour bénéficier des données produites par l’établissement public… et donc en partie avec l’argent public. D’autres acteurs de notre communauté en faisant déjà echo il y a bien des années, et la situation n’a pas changé : https://blog.bacpluszero.com/2014/06/comment-jai-failli-faire-doubler-le.html.

Nos adhérents et administrateurs lors d’une visite chez Météo-France, en 2016. Malgré un partenariat depuis 2009, l’établissement public éprouve toujours des difficultés à partager ses données avec la communauté, mais s’engage à ses côtés dans la formation et le support technique. En mémoire de nos bénévoles disparus Pouic, Mich’, Enzo.

SB : Notre force, c’est de pouvoir bénéficier d’une totale indépendance, grâce à nos adhérents, mécènes et donateurs. On a réalisé le site dont on a toujours rêvé, pas celui qui générera le plus de trafic possible pour en tirer un revenu. Les données des stations météo que nous finançons sont toutes placées sous licences ouvertes, et nos communications sont rigoureuses et factuelles plutôt que « putaclic » (ce qui nous vaut d’ailleurs une notoriété encore assez limitée chez le grand public, en dehors des photos de nos contributeurs reprises dans les bulletins météo de France TV notamment).

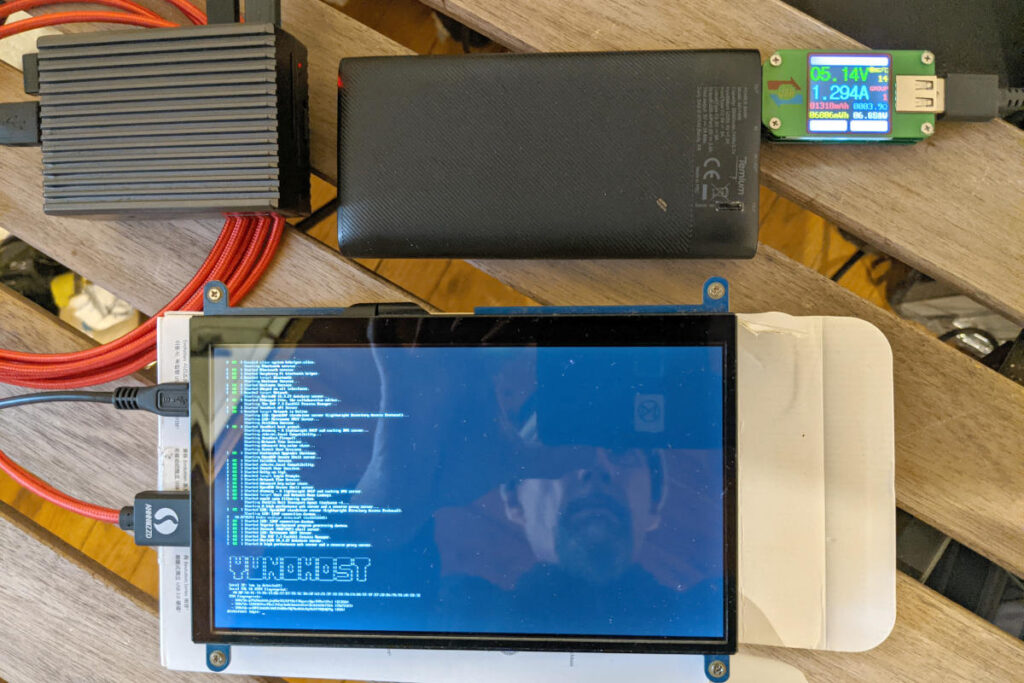

Trouvez-vous aussi votre indépendance vis-à-vis des GAFAM ?

FA : Cela reste encore perfectible : si nous croyons à notre indépendance et au respect des utilisateurs, il y aurait encore des reproches à nous faire. Nous mettons vraiment beaucoup en place pour respecter les données (qu’elles soient météo, personnelles, ou les droits des photographes), nous auto-hébergeons l’immense majorité des contenus (sur 12 serveurs dédiés OVH, du cloud Scaleway, et des machines gracieusement prêtées par Gandi, et même un NAS chez un administrateur fibré !), et essayons d’éviter les services tiers, et les fuyons au possible lorsqu’ils sont hébergés ou contrôlés à l’étranger. Mais tout n’est pas toujours si simple.

Par exemple, nous utilisions jusqu’à très récemment encore Google Analytics, par « simplicité » : tout notre historique depuis 2008 y est stocké, et une instance Matomo assez dimensionnée pour 150M de pages vues par an, ça veut dire gérer une nouvelle machine, et des coûts supplémentaires… pour une utilisation assez marginale, notre exploitation des statistiques étant très basique, puisque pas de publicités et pas de « conversions » ou « cibles d’audience »… Mais tout de même appréciée des bénévoles pour analyser la fréquentation et l’usage des rubriques du site. Il doit aussi traîner quelques polices de caractères hébergées par Google, mais tout le reste est 100 % auto-hébergé et/ou « fait maison ».

Nos cartes sont complexes et nécessitent des données géospatiales de bonne qualité, et à jour. Maintenir à jour une telle base, seuls, et à l’échelle mondiale, est… un projet à lui tout seul.

Nous sommes aussi de gros consommateurs de contenus cartographiques, et proposons des interfaces de visualisation mondiales plutôt jolies (basées sur OpenLayers plutôt que GoogleMaps), mais qui nécessitent des extractions de données particulières (juste les villes, un modèle de terrain haute résolution, ou bien juste les rivières ou limites administratives). C’est un sujet qui peut aussi être vite difficile à gérer.

À une époque, on stockait donc une copie partielle de la base de données OpenStreetMap sur l’Europe, et je générais moi-même des carto avec Tilemill / Mapserver / Geowebcache et des styles personnalisés. Les ressources nécessaires pour faire ça étaient immenses (disque et CPU), la complexité technique était grande, et que dire quand il faut tenir toutes ces bases à jour. C’est un projet à lui tout seul, et on ne peut pas toujours réinventer la roue. Bref, pour le moment, nous utilisons les coûteux services de Mapbox.

Vous nous avez parlé de certaines limites dans votre travail bénévole, qu’est-ce qui vous pose problème ?

FA : Le problème majeur, c’est le développement web du site. La majorité de nos outils sont basés sur le site web : cartes, graphiques, statistiques climatiques, espaces d’échange, contenus pédagogiques, tout est numérique. Aujourd’hui, et depuis 13 ans, le développement et la maintenance du site et de ses serveurs repose sur un seul bénévole (moi !). Déjà, ce n’est pas soutenable humainement, mais c’est aussi assez dangereux.

La raison est simple : un logiciel avec 400.000 lignes de code, 12 serveurs, des technologies « compliquées » (formats de fichiers spécifiques à la météo, cartes interactives, milliards d’enregistrements, bases de données de plusieurs téraoctets,…), ce n’est pas à la portée du premier bénévole qui se pointe ! Et il faut aussi beaucoup d’accompagnement, ce qui est difficile à combiner avec la charge de travail existante.

Pour les plus geeks d’entre-vous, concrètement, voici les technos sur lesquelles sont basées nos plateformes : PHP (sans framework ni ORM !), Javascript/jQuery, OpenLayers, Leaflet, Highcharts, Materialize (CSS), pas mal de Python pour le traitement de données météo (Scipy/Numpy) du NGINX, et pour les spécifiques à notre monde, énormément de GDAL et mapserver, geowebcache, des outils loufoques comme NCL, des librairies pour lire et écrire des formats de fichiers dans tous les sens (BUFR, SYNOP, METAR, GRIB2, NetCDF).

Et bien sûr surtout MariaDB, en mode réplication (et bientôt on aura besoin d’un mode « cluster » pour scaler), des protocoles de passage de message (RabbitMQ, WebSockets), de l’ElasticSearch et SphinxSearch pour la recherche fulltext, et du Redis + Memcached pour les caches applicatifs.

Au niveau infra, évidemment de la gestion de firewall, de bannissement automatique des IP, un peu de répartition de charge, de l’IP-failover, un réseau dédié entre machines (« vRack » chez OVH), beaucoup de partages NFS ou de systèmes de fichiers distribués (GlusterFS, mais c’est compliqué à maintenir donc on essaie de migrer vers de l’Object-Storage type S3).

Et on a aussi une appli mobile Android en Java, et iOS en Swift, mais elles sont vieillissantes, fautes de moyens (leur développement a été sous-traité), et la majorité des fonctionnalités est de toutes façons destinée à être intégrée sur le site en mode « responsive design ».

Je passe sur la nécessité de s’interfacer avec des API externes (envois de mails, récupération de données météo sur des serveurs OpenData, parsing de données météo, API de la banque pour les paiements d’adhésions), des outils de gestion interne (Google Workspace, qui est « gratuit » pour les assos, hé oui !), des serveurs FTP et VPN pour connecter nos stations météo, un Gitlab auto-hébergé pour le ticketing et le code source …

SB : On a aussi des difficultés à dégager du temps pour d’autres actions : installer des stations météo par exemple, ce n’est pas négligeable. Il faut démarcher des propriétaires, obtenir des autorisations, parfois signer des conventions compliquées avec des collectivités locales, gérer des problématiques « Natura 2000 » ou « Bâtiments de France », aller sur site,… c’est assez complexe. Nous essayons de nous reposer au maximum sur notre communauté de bénévoles et adhérents pour nous y assister.

Quels sont vos besoins actuels ?

SB : Dans l’idéal, et pour venir en renfort de Frédéric, nous aurions besoin d’un développeur « full-stack » PHP à plein temps, et d’un DevOps pour pouvoir améliorer l’architecture de tout ça (qui n’est plus au goût des stacks technologiques modernes, et sent un peu trop l’année 2010 plutôt que 2022, ce qui rend la maintenance compliquée alors que le trafic web généré suppose de la perf’ et des optimisations à tous les niveaux).

Ce n’était pas immédiatement possible au vu des revenus de l’association, qui atteignaient environ 60.000€ en 2021, dont 15.000€ sont dépensés en frais de serveurs dédiés chez OVH (passer au tout-cloud coûte trop cher, en temps comme en argent,… mais gérer des serveurs aussi !).

FA : On développe aussi deux applis Android et iOS, qui reprennent les contenus du site dans un format simplifié, et surtout permettent de recevoir des alertes « push » selon les conditions météo, et d’afficher des widgets. Elles sont dans le même esprit que le site (pas de pubs, le moins de contenus tiers possibles), cependant ce sont des applis que l’on a sous-traité à un freelance, ce qui finit par coûter très cher. Nous réfléchissons à quelle direction donner à celles-ci, surtout au vu de l’essor de la version « responsive » de notre site.

Nous aimerions commencer à donner une direction européenne à notre plateforme, et la mettre à disposition des communautés d’autres pays. Il y a un gros travail de traduction, mais surtout de travaux techniques pour rendre les pages de notre site « traduisibles » dans différentes langues.

Vous ouvrez cette année un premier poste salarié, quelle a été votre démarche ?

SB : Dès lors, nous avions surtout un besoin intermédiaire, qui vise à faire progresser nos revenus. Pour cela, notre première marche sur l’escalier de la réussite, c’est de recruter un·e chargé·e de développement associatif, chargé d’épauler les bénévoles du Conseil d’Administration à trouver des fonds : mécènes et subventionneurs publics. Les sujets climat sont au cœur du débat public aujourd’hui, l’engagement citoyen aussi (on l’a vu avec CovidTracker !), nous y participons depuis 20 ans, mais sans savoir nous « vendre ».

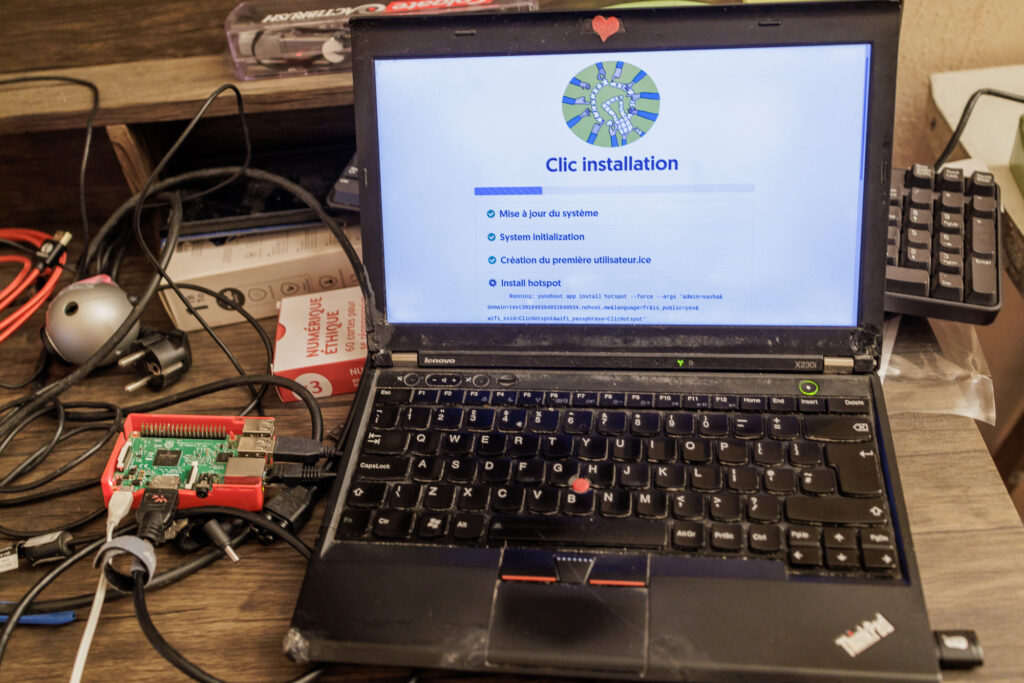

FA : Cette première marche, nous l’avons franchie grâce à Gandi, dans le cadre de son programme « Gandi Soutient », qui nous a mis en relation avec vous, Framasoft. Vous êtes gentiment intervenus auprès de nos membres de Conseil d’Administration, et vous nous avez rassurés sur la capacité d’une petite association à se confronter aux monopoles commerciaux, en gardant ses valeurs fondatrices. Sans votre intervention, nous n’aurions probablement pas franchi le pas, du moins pas aussi vite !

SB : Cela va nous permettre de faire souffler une partie de nos bénévoles. Même si cela nous fait peur, car c’est une étape que nous n’osions pas franchir pour préserver nos valeurs, c’est avec une certaine fierté que nous pouvons aujourd’hui dire : « nous sommes une asso d’intérêt général, nous proposons un emploi au bénéfice de tous, et qui prend sa part dans la mobilisation contre le changement climatique, en en donnant des clés de compréhension aux citoyens ».

FA : La seconde étape, c’est recruter un⋅e dév’ web full-stack PHP/JS, quelqu’un qui n’aurait pas été impressionné par ma liste de technos évoquée précédemment ! Comme nous avons eu un soutien particulièrement fort de notre communauté en ce début d’année, et que notre trésorerie le permet, nous avons accéléré le mouvement, et la fiche de poste est d’ores-et-déjà disponible, pour un recrutement envisagé à l’été 2022.

Comment pouvons-nous soutenir Infoclimat, même sans s’y connaître en stations météo ?

FA : Pour celles et ceux qui en ont les moyens, ils peuvent nous soutenir financièrement : c’est le nerf de la guerre. Quelques euros sont déjà un beau geste ; et pour les entreprises qui utilisent quotidiennement nos données (on vous voit !), un soutien plus important permet à nos outils de continuer à exister. C’est par exemple le cas d’un de nos mécènes, la Compagnie Nationale du Rhône, qui produit de l’électricité hydroélectrique et éolienne, et est donc légitimement intéressée de soutenir une asso qui contribue au développement des données météo !

Pour cela, nous avons un dossier tout prêt pour expliquer le détail de nos actions auprès des décideurs. Pour aller plus loin, une seule adresse : association@infoclimat.fr

Et pour ceux qui veulent aussi s’investir, nous avons une page spécifique qui détaille le type de tâches bénévoles réalisables : https://www.infoclimat.fr/contribuer.

Ce n’est pas exhaustif, il y a bien d’autres moyens de nous épauler bénévolement, pour celles et ceux qui sont prêts à mettre les mains dans le cambouis : des webdesigners, développeurs aguerris, experts du traitement de données géographique, « datavizualisateurs », ou même des gens qui veulent faire de l’IA sur des séries de données pour en trouver les erreurs et biais : il y a d’infinies possibilités ! Je ne vous cacherai pas que le ticket d’entrée est assez élevé du point de vue de la technique, cela dit…

SB : Pour les autres, il reste l’énorme possibilité de participer au site en reportant des observations via le web ou l’appli mobile (une paire d’yeux suffit !) ainsi que des photos, ou… simplement nous faire connaître ! Une fois comprise la différence entre Infoclimat et tous les sites météo, dans le mode de fonctionnement et l’exploitation commerciale ou non des données, on comprend vite que notre association produit vraiment de la valeur au service des citoyens, sans simplement profiter des données des autres, sans apporter sa pierre à l’édifice, comme le font nonchalamment d’autres initiatives. Par ailleurs, nous avions pour projet d’avoir une page sur Wikipédia, refusée par manque de notoriété :( . Idem pour la demande de certification du compte Twitter de l’Association, qui pourtant relaie de l’information vérifiée et montre son utilité lors des événements météo dangereux ou inhabituels, comme lors de l’éruption tout récente du volcan Hunga Tonga-Hunga Ha’apai sur les Iles Tonga qui a été détectée 15h plus tard et 17.000 km plus loin par nos stations météo lors du passage de l’onde de choc sur la métropole !

FA : Infoclimat, c’est un peu l’OpenFoodFacts du Yuka, l’OpenStreetMap du GoogleMaps, le PeerTube du YouTube, le Wikipédia de l’Encarta (pour les plus vieux)… et surtout une formidable communauté, que l’on en profite pour remercier ici !

On vous laisse maintenant le mot de la fin !

SB : Bien sûr, on aimerait remercier tous ceux qui ont permis à cette aventure de progresser : tous les bénévoles qui ont œuvré depuis 20 ans, tous les adhérent⋅e⋅s qui ont apporté leur pierre, nos mécènes et donateurs, ainsi que les passionnés qui alimentent le site et nous soutiennent depuis toutes ces années !

FA : Le soutien de Gandi et Framasoft a aussi été un déclencheur, et j’espère que cela pourra continuer à être fructueux, au service d’un monde meilleur et désintéressé. Des initiatives comme la notre montrent qu’être une asso, ça permet de produire autant voire plus de valeur que bien des start-up ou qu’un gros groupe qu’on voit passer dans le paysage météo. Et pourtant, nous sommes souvent bien moins soutenus, ou compris.

Resources à consulter :

- Site internet de l’association Infoclimat : asso.infoclimat.fr

- Site internet des outils météorologiques et climatologiques : infoclimat.fr

- Offres d’emploi de Infoclimat : infoclimat.fr/recrutement

- Dossier de présentation de Infoclimat : asso.infoclimat.fr/infos